智东西内参|上海只排第五!IDC发布2021-2022中国 模型( 二 )

需求和供给两方面的变化不断推进人工智能芯片行业和技术的多元化创新发展:

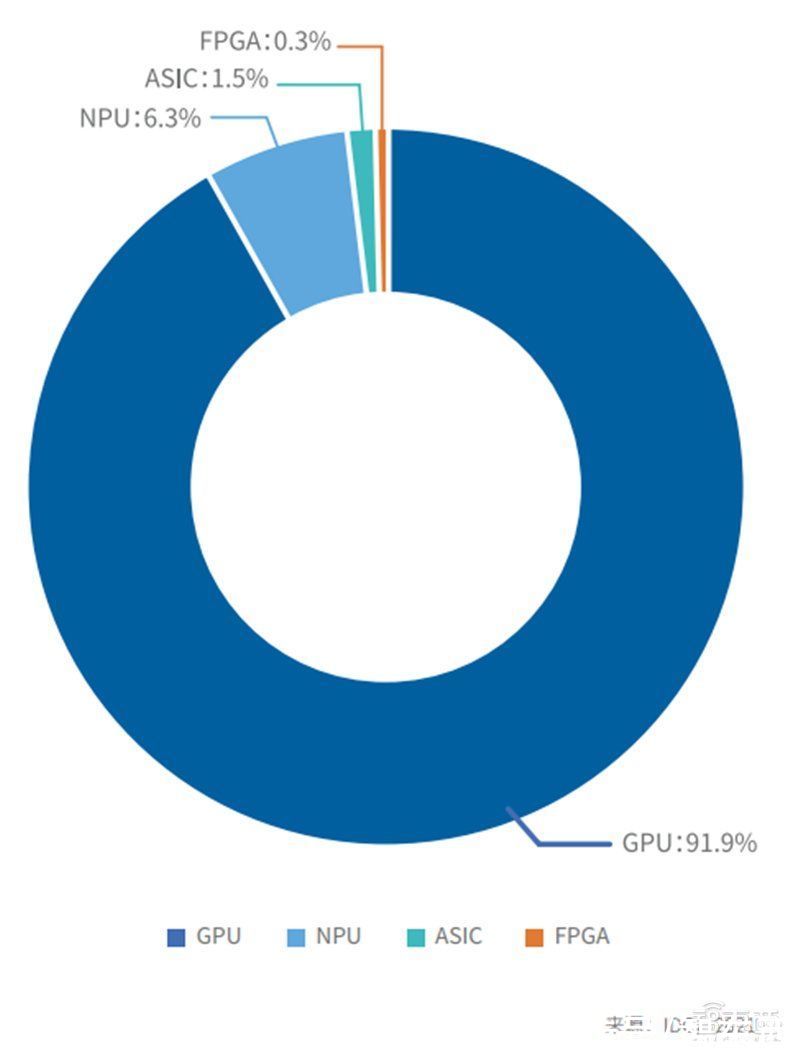

AI芯片主要包括图形处理器(GPU)、现场可编程门阵列(FPGA)、专用集成电路(ASIC)、神经拟态芯片(NPU)等。人工智能深度学习需要异常强大的并行处理能力。芯片厂商正在通过不断研发和升级新的芯片产品来应对这一挑战,特别是 GPU,同样也包括 FPGA、ASIC 和 NPU 等。

IDC 研究发现,2021 年上半年中国人工智能芯片中,GPU 依然是实现数据中心加速的首选,占有 90% 以上的市场份额,而 ASIC,FPGA,NPU等其他非 GPU 芯片也在各个行业和领域被越来越多地采用,整体市场份额接近 10%,预计到 2025 年其占比将超过 20%。 神经拟态芯片具有低功耗、低延迟、高处理速度等优势,其产业化和商业化还在持续演进中,机器学习的发展和对脑研究的深入将为神经拟态芯片的进一步发展带来更多可能性。

文章插图

中国人工智能服务器市场规模(按加速卡类型)

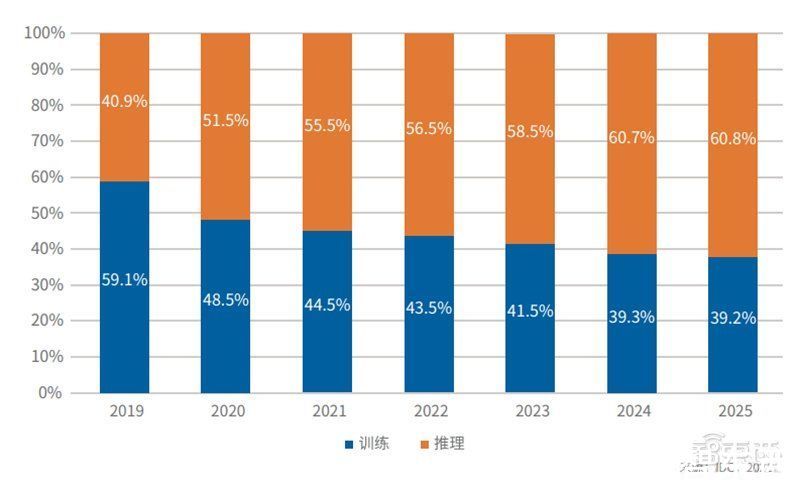

人工智能芯片需要完成对于推理与训练任务的高效支撑。训练是指借助已有的大量数据样本进行学习,获得诸如更准确的识别和分类等能力的过程,对计算的精度要求较高,它直接影响推断的准确度。这就要求训练芯片应具有强大的单芯片计算能力,目前 GPU 芯片被认为更适合用于承担训练负载。而推理过程则是指对新的数据,使用这些能力完成特定任务(比如分类、识别等)。

根据 IDC 研究发现,2020 年中国数据中心用于推理的芯片的市场份额已经超过 50%,预计到 2025 年,用于推理的工作负载的芯片将达到60.8%。目前市场来看,单芯片的推理能力将逐渐增强,将单芯片算力耗尽的推理任务和小规模推理任务将出现混合部署趋势,芯片会逐步加强对于虚拟化技术的支持。

文章插图

人工智能服务器推理和训练工作负载预测,2019-2025

人工智能芯片可部署在云端数据中心、边缘侧和终端侧。云计算为人工智能提供了基础架构,目前云端是承载海量数据处理和大规模计算的重要载体。云端人工智能芯片需要具备高存储容量,高浮点处理速度以及高可扩展性。在新技术的驱动下,5G 等连接技术降低了数据的传输和处理速度,为了分担数据中心的计算压力并且也能提高实时响应速度,人工智能在边缘侧的处理将成为企业的一个关键增长领域。边缘侧人工智能芯片部署规模大且分散,未来边缘智能芯片需求将迅速增长,这就要求芯片需要具备适配各类复杂环境的能力。人工智能在边缘以及端侧将有广泛的应用场景,从自动驾驶到工业制造,再到消费者智能家居和可穿戴设备,处于端侧、边缘侧的人工智能芯片需要在功耗、计算性能、形状和物料成本之间取得平衡。

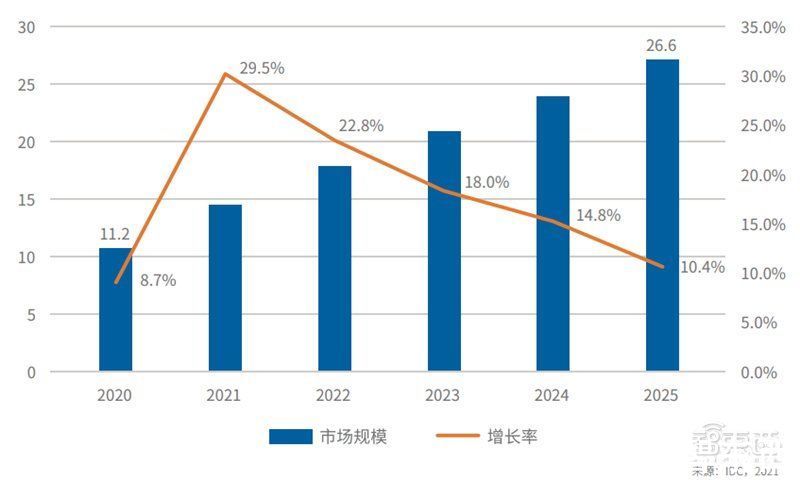

2、服务器人工智能服务器具有超高计算性能,是 AI应用的核心基础设施。全球范围来看,人工智能软件的增长等因素很大程度上推动了人工智能服务器市场的增长。新冠疫情给全球人工智能服务器市场带来了极大的影响,预计 2021 年和 2022年人工智能服务器市场将逐渐恢复其强劲的增长,并在 2023 年回到新冠疫情以前的轨道。IDC 全球调研显示,超过一半的企业在 2020 年人工智能基础设施上的支出超过 1000 万美元。预计到 2025 年,全球人工智能服务器市场规模将超过 260 亿美元。

文章插图

全球人工智能服务器市场及预测,2020-2025 (十亿美元)

在中国,数字经济的发展和 AI 应用的落地引领中国 AI 服务器市场的不断增长。新基建投资计划是新冠肺炎疫情后经济复苏的新动力,它将与 IT 支出密切相关。中国 AI 基础架构还需要进一步发展,AI 服务器的需求还是十分迫切的。

- 荣耀|今年过节不乱跑,荣耀智慧屏1499起,和年夜饭一样真香

- 苹果|国内首款支持苹果HomeKit的智能门锁发布:iPhone一碰即开门

- CPU|元宇宙+高端制造+人工智能!公司已投高科技超100亿,股价仅3元

- 智能|地震救人新突破!中科院研制出触嗅一体智能仿生机械手

- 智能制造|企业转型的新时代,夹缝中求生存

- DeepMind首席科学家:比起机器智能,我更担心人类智能造成的灾难

- Aqara 智能门锁 A100 Pro 发布:支持苹果“家庭钥匙”解锁

- 资讯丨智能DHT+高阶智能驾驶辅助,魏牌开启“0焦虑智能电动”新赛道

- 智能手机|全球第17位!App Annie报告:2021年中国人均每天用手机3.3小时

- 赵明路|华为终端申请注册鸿蒙智联商标,国际分类涉服装鞋帽