研究人员|如何让人模仿猎豹走路?Stuart Russell提出基于最优传输的跨域模仿学习( 二 )

为了跳过学习专家奖励函数,Ho & Ermon 证明了 RL 是占用度量匹配问题的对偶,并提出了一个对抗性目标,该目标的优化近似恢复专家的状态-动作占用度量,以及使用生成式对抗网络的实用算法。虽然最近的一些工作旨在改进该算法相对于由极大极小优化引起的训练不稳定性,Primal Wasserstein模仿学习(PWIL)和 Sinkhorn 模仿学习(SIL)将 IL视为占用措施之间的最优传输问题,以完全消除极大极小目标,并在样本效率方面优于对抗性方法。

还有其他研究人员将模仿学习扩展到复杂的类人运动和非琐碎设置中的游戏行为。从 Wasserstein 到 Gromov-Wasserstein,该论文工作是对 Dadashi 等人以及 Papagiannis 和 Li 的延伸,从而超越了专家和模仿者在同一域中的限制,并进入了生活在不同空间中的智能体之间的跨域设置。

跨域和形态的迁移学习。在 RL 中,不同域之间传递知识的工作通常会学习状态空间和动作空间之间的映射。Ammar 等人使用无监督流形对齐,在具有相似局部几何形状但假定可以获得手工制作特征的状态之间找到线性映射。最近在跨视点迁移学习和实施例不匹配方面的工作学习了不需要手工特性的状态映射,但假设可以从两个领域获得成对和时间对齐的演示。

此外,Kim 等人和 Raychaudhuri 等人提出了从未配对和未对齐任务中学习状态映射的方法。所有这些方法都需要智能体任务,即来自两个域的一组专家演示,这限制了这些方法在现实世界中的适用性。Stadie等人提出将对抗学习和域混淆结合起来,在不需要智能体任务的情况下在智能体域学习策略,但他们的方法仅适用于小视点不匹配的情况。Zakka等人采用目标驱动的观点,试图模拟任务进程,而不是匹配细粒度的结构细节,以便在物理机器人之间转换。

相比之下,这篇论文的方法不依赖于学习智能体之间的显式跨域潜在空间,也不依赖于智能体任务。GromovWasserstein 距离使研究人员能够在没有共享空间的情况下直接比较不同的空间。现有基准测试任务假设可以访问来自两个智能体的一组演示,而这篇论文中的实验仅假设可以访问专家演示。

文章插图

文章插图

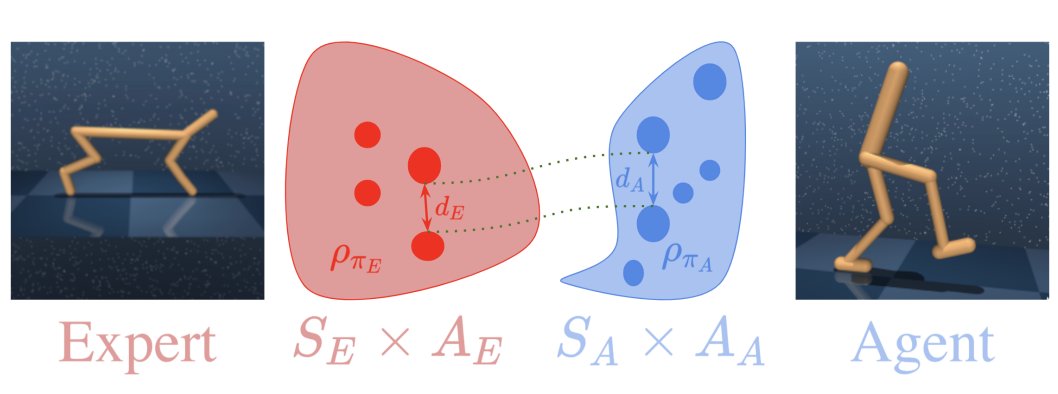

图注:Gromov-Wasserstein 距离使我们能够比较具有不同动态和状态-动作空间的两个智能体的平稳的状态-动作分布。我们将其用作跨域模仿学习的伪奖励。

文章插图

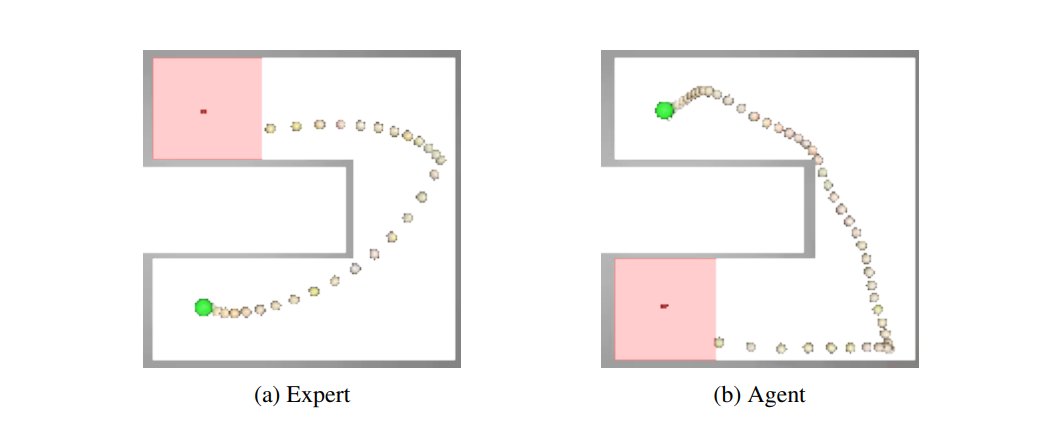

图注:给定专家域(a)中的单个专家轨迹,GWIL 在没有任何外部奖励的情况下恢复智能体域(b)中的最优策略。绿点表示初始状态位置,当智能体达到红色方块表示的目标时,事件结束。

- 小米科技|不聊性能只谈拍照!新旗舰反向升级成潮流,拍照手机如何选?

- 搜索引擎|淘宝运营系统出台春节打烊功能,淘宝运营商家该如何选择?

- 小米科技|RTX3060的性能到底如何?相比RTX2060提升有多大?

- 市值超 1.7 万亿的Netflix是如何做决策的?

- 腾讯|前腾讯员工爆料:鹅厂的末位淘汰制让人心理崩溃!

- QQ音乐的2021专辑盘点,是如何征服资深乐迷的

- 饭饭1080°平台分析之生鲜电商平台如何选择ERP系统和SAAS系统

- 在2021大中华区艾菲国际论坛上|玛雅文化施葵:新消费时代,如何助力品牌跑出“破圈”加速度?

- 布局潮范多元化圈层 看MAZDA3昂克赛拉如何玩出花样?

- 原标题:月背工作满三年|月背工作三年 嫦娥四号如何做到超服期役?专家回应