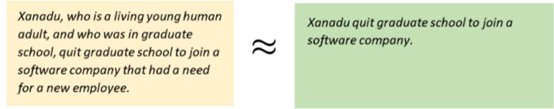

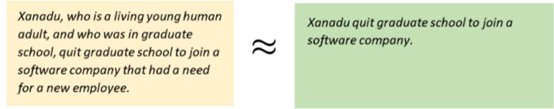

这两种过程都在发生和演进,最后似乎也得到了不错的平衡吗,说话者和听者的总体工作都得到了同样的优化。该优化减少了说话者的编码信息,忽略了假设听众已知的其他信息,但不会造成对话的背景信息丢失。举个例子,对比下面黄色框中的未优化的文本和绿色框中优化的(等效但小得多的)文本。

文章插图

绿色框中较短的信息(我们通常就是这样说话的)传达了与较长的盒子相同的思想。通常,我们不会明确说明所有其他内容,因为我们都知道。这种技能几乎花了人类20万年的进化。但这就是NLU的问题所在:机器不知道我们遗漏了什么,它们不知道我们都知道什么。最终结果是NLU非常困难,如果它们不能以某种方式"整理"我们话语的所有的含义,那么软件程序将永远不能完全理解我们话语背后的想法。NLU的挑战,并不是解析,阻止,POS标记,命名实体识别等, 而是解释或揭示那些缺失的信息。并隐含地假定为共享和共同的背景知识。在此背景下,我们现在提供三个原因,说明为什么机器学习和数据驱动的方法不会为自然语言理解提供解决方案。1、ML 方法甚至与 NLU 无关:ML 是压缩的,语言理解需要解压缩上述讨论(希望)是一个令人信服的论点,即机器的自然语言理解由于MTP(媒体传输协议,Media Transfer Protocol)而变得困难,因为我们日常口语被高度压缩,因此"理解"的挑战在于未压缩(或发现)缺失的文本。机器的语言理解是困难的,因为机器不知道我们都知道什么。但 MTP 现象正是为什么数据驱动和机器学习方法虽然在某些 NLP 任务中可能很有用,但与 NLU 甚至不相关的原因。在这里,我们提出这个证据:机器可学习性(ML) 和可压缩性(COMP)之间的等价性已在数学上建立。即已经确定,只有在数据高度可压缩(未压缩的数据有大量冗余)时,才能从数据集中学习,反之亦然。虽然可压缩性和可学习性之间的证明在技术上相当复杂,但其实很容易理解:学习是关于消化大量数据并在多维空间中找到一个"覆盖"整个数据集(以及看不见的的函数具有相同模式/分布的数据)。因此,当所有数据点都可以压缩时,就会发生可学习性。但是 MTP 告诉我们 NLU 是关于解压缩的。因此,我们梳理出以下内容:机器学习是关于发现将大量数据概括为单一函数。另一方面,由于MTP,自然语言理解需要智能的"不压缩"技术,可以发现所有缺失和隐含的假定文本。因此,机器学习和语言理解是不兼容的——事实上,它们是矛盾的。2、ML 方法甚至与 NLU 无关:统计上的无意义ML 本质上是一种基于在数据中找到一些模式(相关性)的范式。因此,该范式的希望是在捕捉自然语言中的各种现象时,发现它们存在统计上的显着差异。但是,请考虑以下事项):奖杯不适合在手提箱,因为它是太 :1a.小 ;1b.大

请注意,"小"和"大"(或"打开"和"关闭"等)等反义词/反义词以相同的概率出现在相同的上下文中。这样,(小)和(大)在统计上等效的,但即使是一个4岁(小)和(大)是显着不同:"它"在(小)是指"手提箱"而在(大)中它指的是"奖杯"。基本上,在简单的语言中,(1 a ) 和 (1 b ) 在统计上是等价的,尽管在语义上远非如此。因此,统计分析不能建模(甚至不能近似)语义——就这么简单!