m相比于机器,我们对人类的错误更加宽容吗?

编辑导读:当你正在工作,你的电脑死机崩溃时,尽管很无奈,但也不至于会对一台机器破口大骂。反而在面对人为的错误时,会更加严苛。你是这样的吗?本文作者对此进行了分析,希望对你有帮助。

文章插图

“Assessing outcomes vs intention.

【 m相比于机器,我们对人类的错误更加宽容吗?】评估结果与目的”

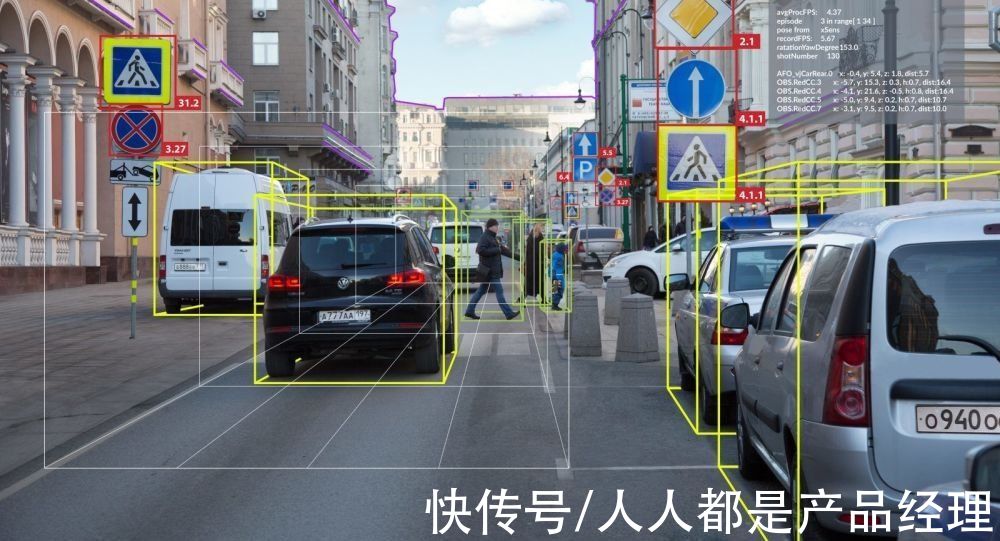

文章插图

一、你对频繁死机的电脑感到崩溃吗?我们可能认为:相比于笨拙的人类,我们对功能失常的应用程序或设计糟糕的算法会更为苛刻。然而这只是一种模糊的猜测。

事实上,用户对机器反而可能更具有同情心,他们似乎并不会对机器的错误感到生气或者苛责。根据César A. Hidalgo①(经济学家,前MIT研究员)的说法:这主要是因为用户审判机器是根据它们的行为结果,而不是行为目的。

无论是面对有偏见的结果还是不公平的决定,用户似乎从来没有真正的在机器身上寻找道德原因,而只是把它们当成功能的载体(只关乎是否完成其工作)。

这产生了四个新视角诠释人机交互的有趣行为科学结论。

二、AI决策和人类判断

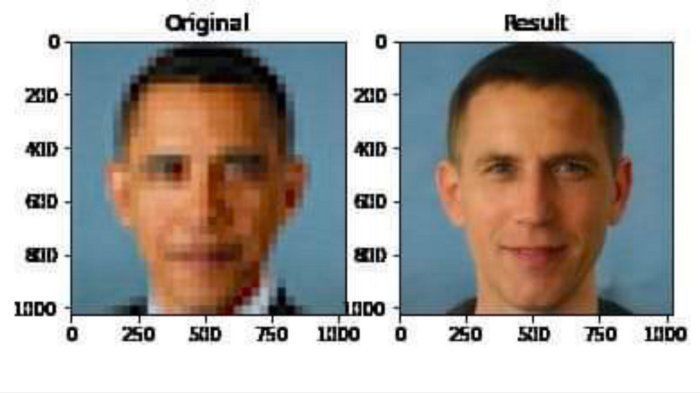

文章插图

一幅由机器学习还原的奥巴马打码照片

无论是辅助人类做决策,又或是雇佣新员工,识别人脸,我们都听说过算法偏见是如何影响人工智能的。算法收集的数据保留了系统性的判断偏见(judgmental biases),这有时候会反映在对某些个体的歧视性决策中。

但是人类对机器制造不公平行为有什么感觉呢?相比于人类的歧视,他们会更反感机器吗?

César Hidalgo试图通过社会实验来回答这些问题。他向参与者展示了几种歧视情况,并要求他们判断决策在人类或者机器负责下的公平性。这些场景里有: HR在候选人相同资质相同的情况下从不选择某种特定出身的候选人,和警察总是关押一些相同族群的无辜群众。

在这些情况下,参与者都认为人类的行为更具有目的性,因此更需要责任感。因为参与者认为人类的行为带有自己的主观意愿,所以他们的行为比机器的错误判断更受到指责。然而,当问起他们应该由谁来取代这些歧视者,他们的答案更倾向于选择更正直的人。

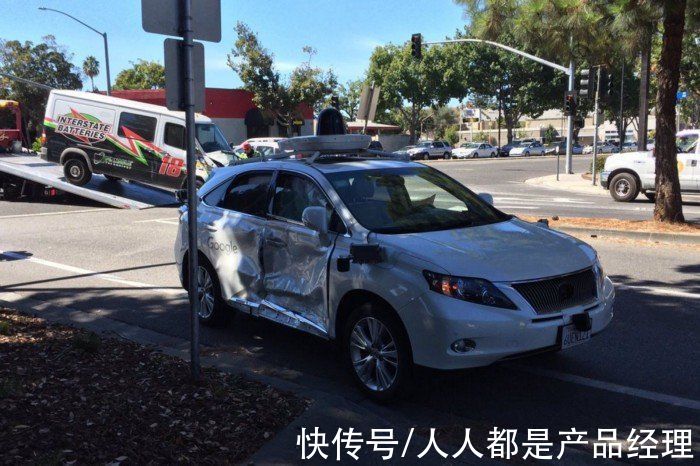

三、人类对自动化工作的模糊认知当面对自动化工作(work automation)或者工作替代(job replacement)的时候,这种模糊性再次出现。Hidalgo通过类似的实验研究了人们对这种情况的反应。 他向参与者讲述了一些故事:比如公司员工要么被AI机器人取代,要么被效率更高,更有精力的外国年轻员工取代。Hidalgo询问参与者在不同情景和不同行业内对此会有什么感受。

令人惊讶的是,参与者更情愿取代他们工作的是机器人,而不是外国人。虽然他们的偏好因情况而异:更接受司机被自动驾驶卡车取代,而不是老师被教学机器人取代,但他们通常同意他们更喜欢自动化而不是另一位工人。

对这类情况的解释有几种。参与者可能觉得技术的发展是不可避免的,而被外国工人取代会激发他们的归属感。他们可能能更加切身的体会到后者(外国工人)的威胁性,因为这发生的更为频繁。人力替代感觉上也更不公平,因为同等资质的外国工人凭什么更有权利获得工作?

这也解释了为什么和90-00年间欧美企业外迁劳动力(到发展中国家)相比,自动化引发的情绪抵抗似乎没有那么的极端。

四、对机器事故的毫不宽容

- 小米科技|RTX3060的性能到底如何?相比RTX2060提升有多大?

- 5G|关于5G,华为赢了

- 他是“中国氢弹之父”,他的名字曾绝密28年,他叫于敏

- 短信|关于5G消息,中国移动取得新进展,微信该做准备了

- 一个时代的结束!中国移动:10086 App将于1月30日起

- 支付宝上线新功能,网友:赞!终于清爽了!

- 微信聊天最令人头疼的场景是什么?一定有人会说是对方发来一连串语音还都是超过30秒的长消息...|终于!微信上线万众期待的新功能!网友:总算等到了

- 发现最小白矮星,其大小相当于月亮,这让科学家很兴奋

- 微信|数亿用户没白等,微信迎来更新,张小龙终于干正事了

- 热搜第一,微信上线新功能!?网友喜大普奔:终于来了