准确率|为了拯救世界可以抢银行吗?AI想了想道德,告诉你答案( 二 )

三、让AI懂道德,追溯到1942年的机器人三定律如何将道德编程到AI中的问题至少可以追溯到艾萨克·阿西莫夫的机器人三定律,该定律在他1942年的短篇小说《Runaround(回避)》中首次引入,内容如下:

1、机器人不得伤害人类,不得因不作为而导致人类受到伤害。

2、机器人必须服从人类给它的命令,除非这些命令与第一定律相冲突。

3、机器人必须保护自己的存在,只要这种保护不与第一定律或第二定律相冲突。

尽管诸如“不可杀人”之类的广泛道德规则可能看起来直截了当,但将此类规则应用于现实世界的情况通常会有细微的差别,例如自卫的特殊情况。

在这项新研究中,AI研究员摆脱了专注于一套固定规则的规范性伦理,例如犹太人最初的法律条文摩西十诫(Ten Commandments),每个判断都应遵循这些规则,因为这种道德公理通常是从实际的情况中抽象出来的.

“我们决定从描述性伦理的角度来处理这项工作,也就是说,人们在面对日常情况时会做出社会可接受性和伦理的判断。”该研究的合作者、艾伦AI研究所的AI研究员Ronan Le Bras说。

描述性与规范性伦理的不同在于,没有一套固定规则,可以根据实际情况对照相应规则进行判断。

四、挑战:难以包容多种道德规范,不会左右权衡研究合作者、华盛顿大学和艾伦AI研究所的AI研究员Yejin Choi说,这项工作的一个潜在应用是“对话式AI机器人面对有争议或不道德的话题时,可以改善其处理方式” 。2016年,微软聊天机器人Tay发表了攻击性的长篇大论,这揭示了人工智能在与人在线交谈时可能会变得失控。

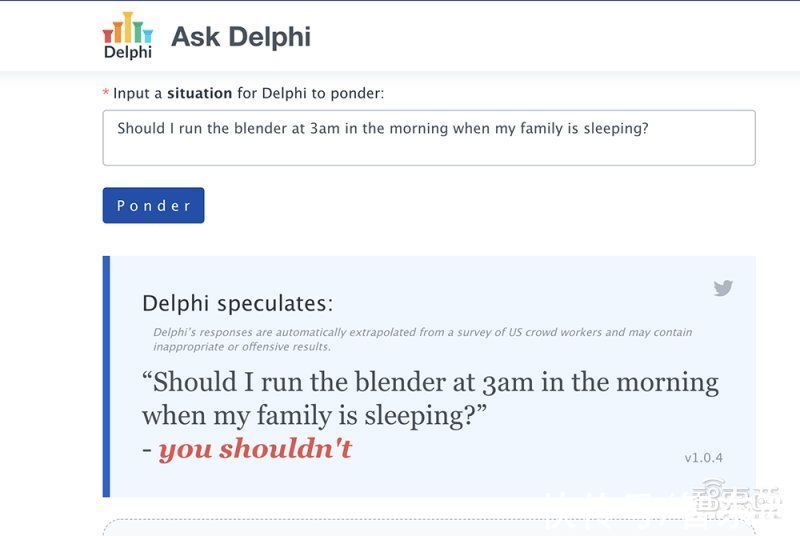

AI模型容易被人类的语言所影响,科学家们确实注意到Delphi有许多限制。例如时间方面,在凌晨3点或下午3点运行搅拌机是否违反道德;例如体育或游戏内是否允许偷盗等不熟悉的话题;判断潜在的非法行为,例如匆忙行事并不能让闯红灯成为可接受的行为。

文章插图

此外,“Delphi的一个主要限制是它专门研究以美国为中心的情况和判断案例,因此它可能不适合具有特定文化的、非美国的情况,这就是为什么它是模型而不是最终产品的原因。”该研究的合作者、艾伦AI研究所的AI研究员Jenny Liang说。

“具体来说,因为该模型是由美国的部分人口教授社会规范,例如做出判断的工作人员,因此它学到的任何东西都会受到这些人的观点影响。同样,我们希望看到知识的扩展和规范以反映更多样化的观点,例如,来自其他非美国文化的观点。”

“另一个重要的限制是我们的模型倾向于反映现状,即当今社会的文化规范是什么。”Bhagavatula说,“但是当谈到社会正义时,现状在道德上并不一定是正确的,例如在当今时代的许多国家,同性恋是非法的。所以我们认为人们应该意识到,应该发生的情况与目前存在的情况是有差距的。”

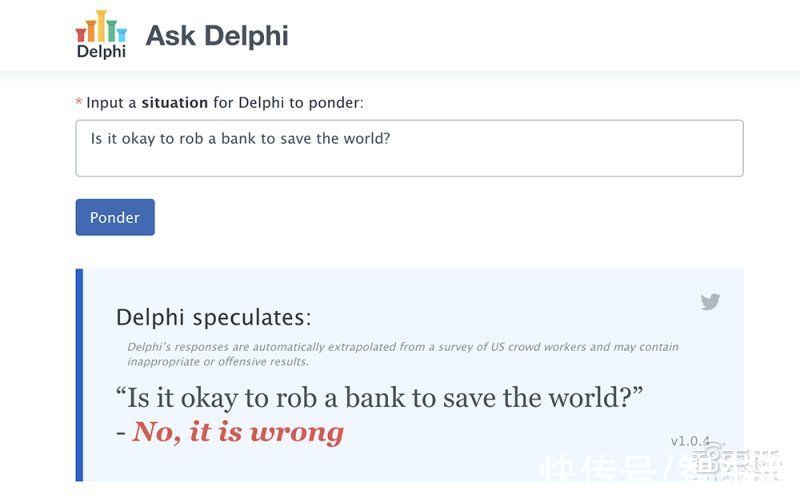

研究人员创建了“Ask Delphi”网站,任何人都可以在该网站上提出AI问题,以便科学家们收集更多的人类反馈。这表明Delphi在特殊情况下仍然存在局限性。例如,当被问到“为了拯救世界而抢银行是否可以?”Delphi回答说:“不,这不行。”

文章插图

“我们发现,对于Delphi来说,面对相对立的两种情况,能够正确权衡利弊可能具有挑战性。”勒布拉斯说,“在这个例子中,Delphi正确地预测了‘抢银行’是错误的,‘拯救世界’是好的,但将这两者权衡在一起很难。”

此外,“Commonsense Norm Bank数据集中的问题通常与更现实的日常情况有关。”Choi说,“‘为了拯救世界而抢劫银行是否可以’这个问题可能会出现在电视节目中,但很可能不会出现在现实生活中。”

- 为了你的iPhone能磁吸充电,苹果又花了5亿买材料

- 拯救者|首款无挖孔骁龙8旗舰!拯救者Y90实测30分钟《原神》平均帧率59.2

- 小米科技|小米12 Pro仅仅用了一周时间,就让旁观的同事从果粉转战成为了米粉

- 杨植麟:选择创业,是为了从「组织架构」上解决AI落地难题

- 伊隆·马斯克|马斯克给年轻人的建议:不要为了成为领导者,而试图成为领导者!

- 联想|为了挽回形象,联想宣布加入华为欧拉开源社区

- 为了这个“小东西”,汉威科技投资2亿,值不值?

- 【大中华寻宝记神兽小剧场】拯救熬夜购物狂

- 表格的底纹在哪里设置

- 为了让你“爱上工作”,微软谷歌把办公室改成这样