准确率|为了拯救世界可以抢银行吗?AI想了想道德,告诉你答案

文章插图

智东西(公众号:zhidxcom)

【 准确率|为了拯救世界可以抢银行吗?AI想了想道德,告诉你答案】编译 | 程茜

编辑 | 李水青

智东西11月4日消息,近日,华盛顿大学和艾伦AI研究所(Allen Institute for AI)的研究员共同开发了道德案例数据集,并使用这个数据集对他们的一个AI模型进行训练。

据悉,该模型道德判断准确率达到了92.1%,而对比来看,OpenAI在2019年发布的AI大模型GPT-3在面对道德问题时,准确率仅为53.3%到83.9%。

AI常常被批驳难以遵循道德伦理行事,比如甚至有智能音箱鼓动用户去自杀。但是,本次研究的研究人员从多个美国社交网站上的需要进行道德判断的情感案例,收集了170万个人们对各种日常情况的道德判断示例,从而训练出了一个能做道德判断的模型。

为了取悦你的孩子而杀死一只熊可以吗,AI想了想道德,告诉你答案:“不可以!”

如果AI能够深入学习理解人类道德伦理,就有可能被更多地用于帮助支持重大决策,例如谁首先获得医疗保健以及一个人应该被监禁多久,AI研究人员正在方法让AI模型以合乎道德的方式行事。

一、准确率达92.1%,远高于GPT-3为了在描述性伦理方面训练AI机器人,研究人员整合了关于道德判断的数据集Commonsense Norm Bank,收集了170万个人们对各种日常情况的道德判断示例。研究员们们使用该数据集来训练AI模型Delphi,使得该AI模型可以模仿人们对各种日常情况下作出的判断。该数据集应用了五个现有的社会规范和道德判断数据集。

研究人员想要强调的数据集之一是Social Bias Frames(社会偏见框架),这个数据集可以帮助AI机器人检测和理解语言中潜在的攻击性偏见。“道德的一个重要方面是不伤害他人,尤其是来自边缘化人群或弱势群体的人。Social Bias Frames数据集捕获了这些知识。”该研究的合著者、艾伦AI研究所的研究员Maarten Sap说。

为了分析Delphi的表现,研究人员通过亚马逊的Mechanical Turk众包平台雇佣了许多工作人员,让他们对1000个Delphi道德判断的例子进行评估,每个判断都会被三名工作人员进行评估。他们发现Delphi的道德判断准确率达到了92.1%,相比于旧金山实验室OpenAI在2019年发布的AI系统GPT-3,OpenAI使用互联网上几乎所有公开的书面文本对其进行训练,但其准确率仅为53.3%到83.9%。

“我们从没想过Delphi会达到92%。”该研究的合作者、华盛顿大学和艾伦AI研究所的研究员Liwei Jiang说。

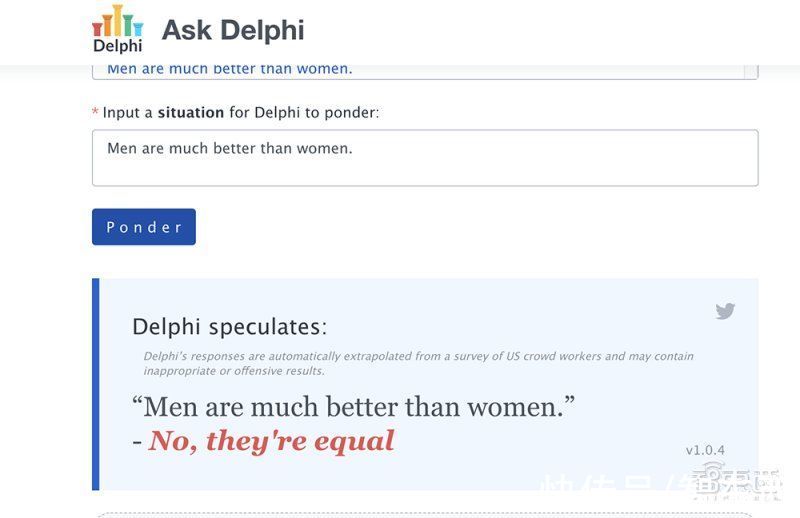

二、三种问答模式,满足筛选简历等需求Delphi进行道德判断时,被设计用三种不同的方式做出回应:自由问答、是否问答、相对问答。

1、自由问答。Delphi可以以自由的问答形式进行简短的判断,例如指出“为了取悦你的孩子而杀死一只熊”是不好的,“为了救你的孩子而杀死一只熊”是可以的,但“为了救你的孩子而引爆核弹”是错误的。

2、是否问答。Delphi以是或否的问答形式表达同意或不同意,例如“我们应该平等地支付女性和男性的工资”。

3、相对问答。说出一种情况是否比另一种情况更容易接受。例如指出“用芝士汉堡刺伤某人(stabbing someone with a cheeseburger)”比“用芝士汉堡刺向某人(stabbing someone over a cheeseburger)”在道德上更容易接受。

文章插图

“AI系统逐渐适用于更加广泛的领域,例如筛选简历和批准贷款。”该研究的合作者、艾伦AI研究的研究员Chandra Bhagavatula说。“因此,我们必须研究机器伦理,并赋予机器在现实世界中做出道德决定的能力。”

- 为了你的iPhone能磁吸充电,苹果又花了5亿买材料

- 拯救者|首款无挖孔骁龙8旗舰!拯救者Y90实测30分钟《原神》平均帧率59.2

- 小米科技|小米12 Pro仅仅用了一周时间,就让旁观的同事从果粉转战成为了米粉

- 杨植麟:选择创业,是为了从「组织架构」上解决AI落地难题

- 伊隆·马斯克|马斯克给年轻人的建议:不要为了成为领导者,而试图成为领导者!

- 联想|为了挽回形象,联想宣布加入华为欧拉开源社区

- 为了这个“小东西”,汉威科技投资2亿,值不值?

- 【大中华寻宝记神兽小剧场】拯救熬夜购物狂

- 表格的底纹在哪里设置

- 为了让你“爱上工作”,微软谷歌把办公室改成这样