y1993珍贵录像:32岁的LeCun向世界亲自展示了首个CNN

文章插图

新智元报道编辑:keyu

【新智元导读】想看看CNN刚被发明的时候是什么样吗?近日,Reddit上公开了一则视频,上面记录了1993年Yann LeCun展示的,用于文本识别的世界上第一个卷积网络,所有人都可以通过当时的视频,亲自深刻感受到,当今经典又伟大的CNN,是如何诞生的。

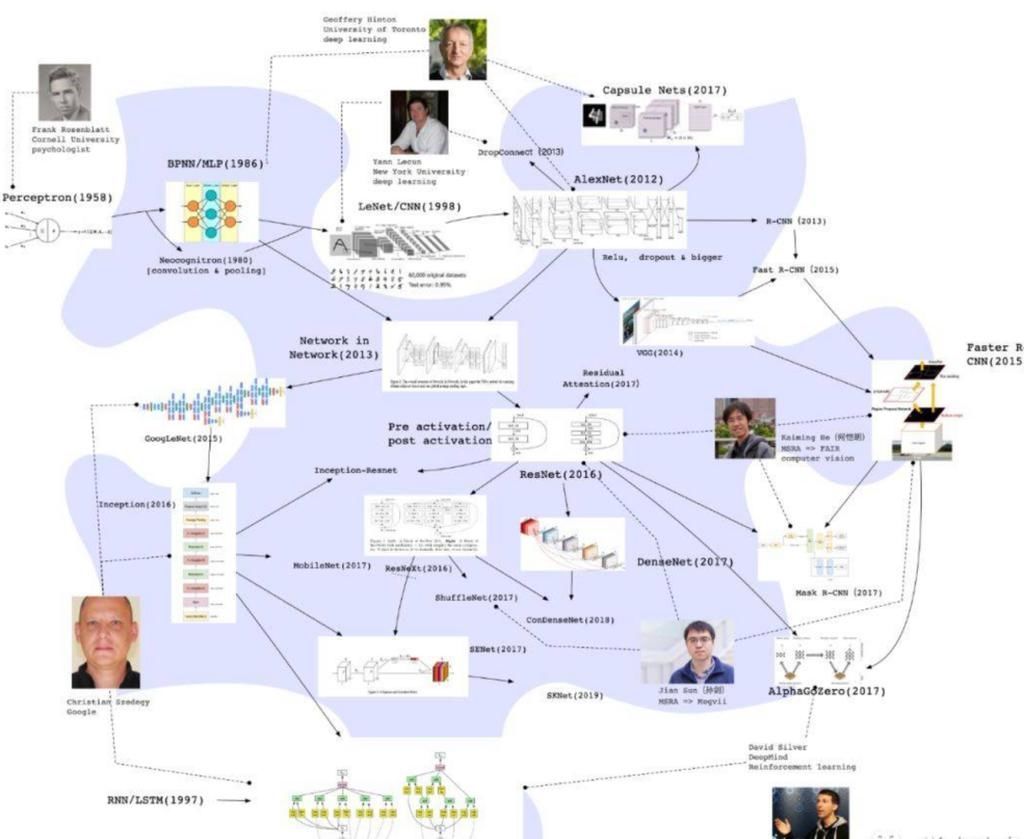

随着AI的发展,卷积神经网络(Convolutional Neural Network,CNN)已经成为从业者使用的最经典,也是最高效的神经网络架构之一。

1980年,日本科学家福岛邦彦在论文《Neocognitron: A self-organizing neural network model for a mechanism of pattern recognition unaffected by shift in position》提出了一个包含卷积层、池化层的神经网络结构。

文章插图

1998年,Yann LeCun等人发表论文《Gradient-Based Learning Applied to Document Recognition》,在其中提出了LeNet-5,将BP算法应用到神经网络结构的训练上,就形成了当代卷积神经网络的雏形。

文章插图

随着之后的不断改进和发展,CNN的框架和结构趋向成熟,性能逐渐进一步上升,从而渐渐演变为了我们现在看到的经典结构。

文章插图

研究者和工业界从业者,也早已经将CNN作为再自然不过的框架,在此基础上进行改进和创新。当然,Yann LeCun也早已成为大家心目中的“深度学习三巨头”之一。至今,CNN已经在图像分类、物体检测、物体追踪、姿态预估、文本检测识别、场景标记、目标定位、物体分割等等领域得到了广泛的应用,为人们的日常生活提供了极大的便利。

都知道,想到并创造出一个新事物,远远比接受和掌握它要困难百倍。

那大家有没有想象过,CNN刚诞生的时候,场景是怎么样的?

今日,Reddit上一则帖子曝光了一段视频:

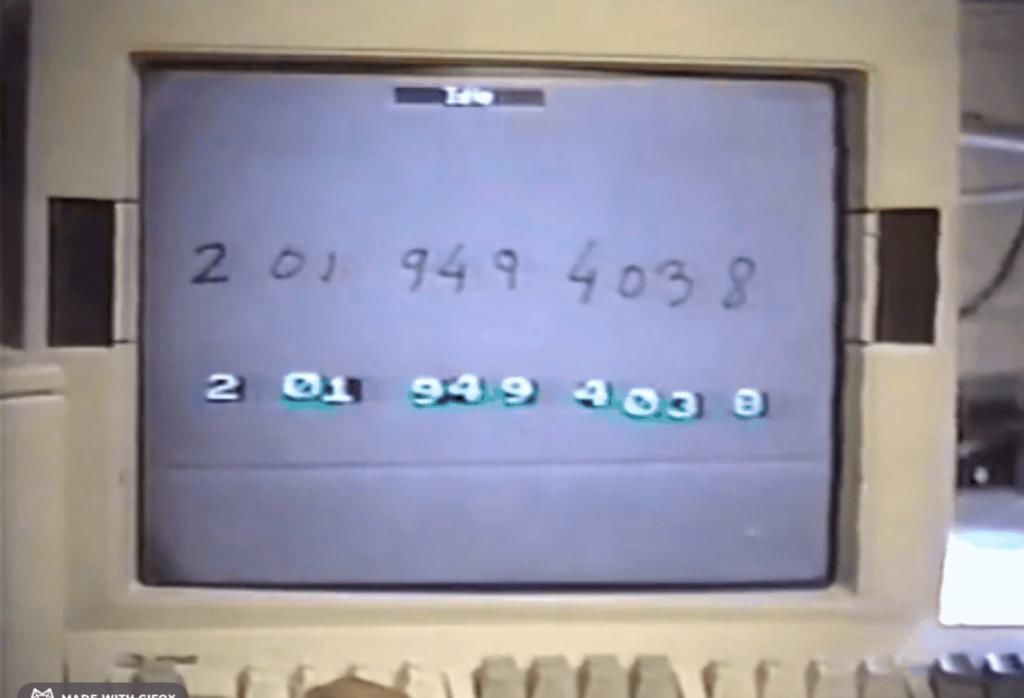

视频上记录了1993年32岁Yann LeCun展示的,用于文本识别的世界上第一个卷积网络。

注意,这是《Gradient-Based Learning Applied to Document Recognition》发布的五年以前。

文章插图

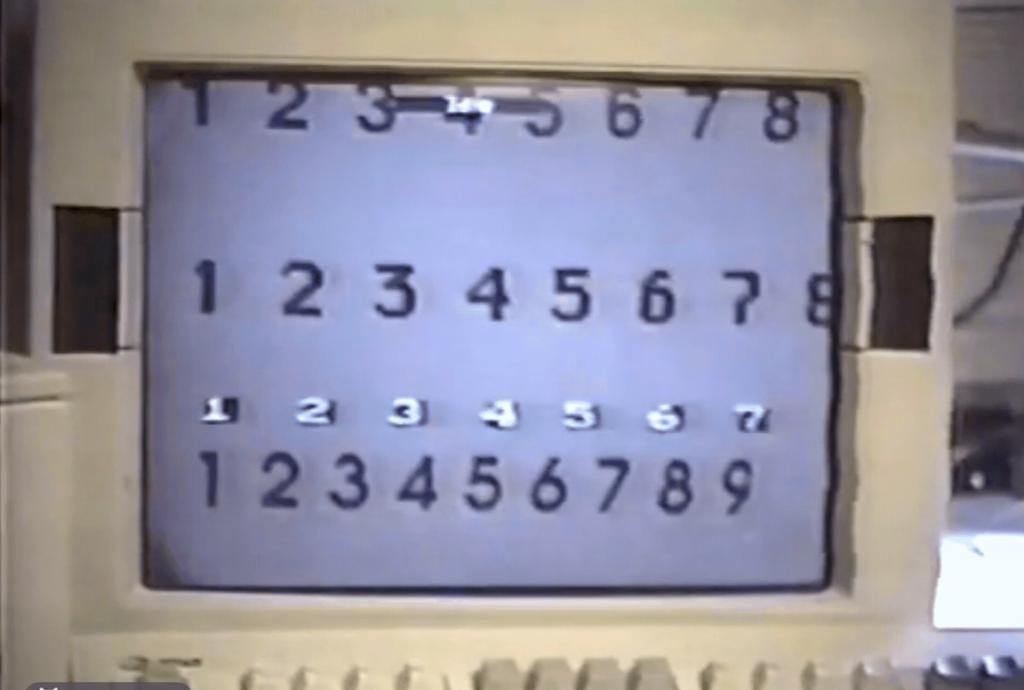

视频中详细展现了当时Lecun等人在手动数字数据集上的实验结果。毫无例外,当时的CNN已经可以以强大的准确率,正确对应输入,表现了完美的结果:

文章插图

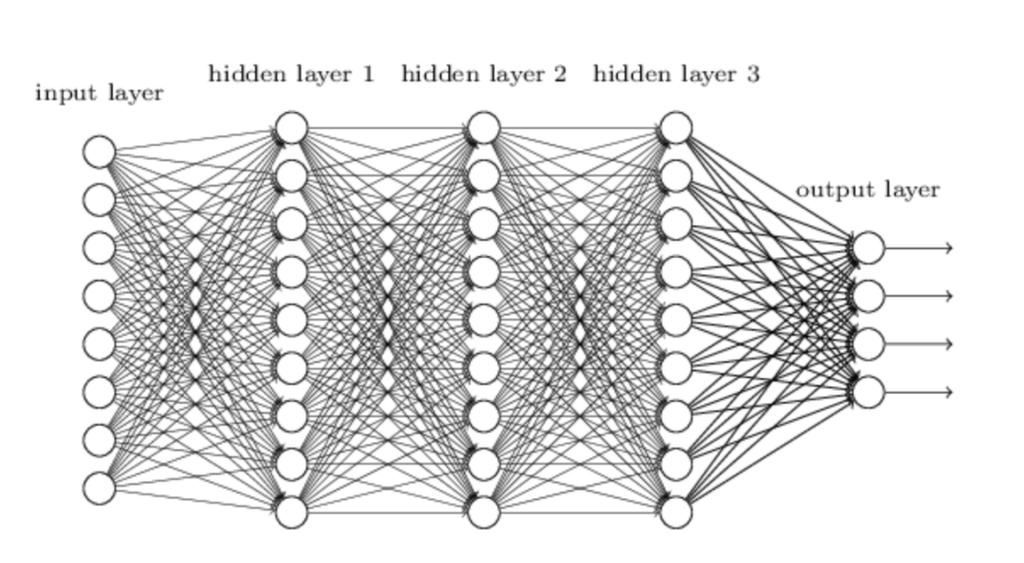

说到这里,我们可以看看过去是如何识别手写数字的,下图是过去识别手写数字的网络结构:

文章插图

每一层网络都和相邻层全部连接。但是这样并没有考虑到图片中像素的空间分布,不管两个像素离的很近还是非常远都一视同仁,显然这样做是不合理的。而CNN的出现,考虑到了输入值的(像素的)空间分布,(再加上一些人工设定的特性 例如共享权重等)使得它非常容易训练。也就可以做出更深层的网络结构,拥有更好的识别效果。

旧神经网络架构上的调整和改变,以及BP算法的引入,使得识别效果发生了惊人的提升,也为经典架构CNN的发展真正叩开了大门。

除此之外,我们还可以发现,算法输出的结果还可以“学习”到输入数字的位置,并且针对不同输入情况,有着极好的鲁棒性,这在1993年,完全称得上令人惊叹。

- 漫画:这才是两口子最真实的状态,平淡却弥足珍贵

- 以色列考古学家从千年沉船上打捞出珍贵文物

- 粉丝众筹PSV掌机传记 明年四月发售、记录珍贵历史

- 影像旗舰新标准!vivo X70 Pro+拍照够惊艳,录像很专业

- CPU|8K 120fps录像!首个国产全幅4900万像素CMOS通过验收

- 自古以来|2200万亿吨珍贵金属“躲”在月球背面,它们哪来的?

- 正在直播UFC268:张伟丽vs罗斯 免费直播及录像回放

- 客服|担心拼夕夕上买的手机是假的,拿快递全程录像开箱

- 矿灯|【前方高能】矿灯会“说话”还能“录像”,这是怎么回事?

- 自媒体|塞宾Smart Mike+在手,录像收音全都有