「发展」的AI伦理治理观:既要「扬善」,也要「除恶」( 二 )

在这样的背景下,建立AI的伦理体系实为大势所趋。为了促进AI技术的良性发展,各方力量承担起了不同的角色。比方说,据联合国统计,全球目前一共出台了超过150份有关AI治理的报告方案,学术界也掀起了「可信AI」、「负责任AI」与「AI向善」等多个新兴话题的研究热潮。

那么,科技公司应该如何承担起AI可持续发展的责任?作为AI产业的先行者,商汤有自己的思考。

首先,AI技术要不要发展?答案无疑是肯定的。正如商汤科技副总裁、商汤人工智能伦理委员会的主席杨帆所说:

「解决技术伦理最简单直接的方法,看起来似乎是不搞技术创新,那么自然就不会存在数字科技的诸多问题。然而,国家要发展,社会要进步,人们的生活质量要改善。前沿科技的发展对家、国、天下都非常重要。如果有顾虑就放弃发展,就是因噎废食。」

「技术发展与技术治理,本身就是制约与平衡的关系,缰绳勒得太早、勒得太死,会制约技术的发展;在技术演进的过程中,适时地收一收绳子、收住技术的底线和边界,才能让技术发展与应用,走得快、走得远。如今,AI已经走出实验室,随着AI通用大装置的日渐发展,机器猜想将带给我们更多的可能,伦理治理由此将更为重要。」

杨帆还表示:「没有理论可以完美得解释技术,但我们要了解技术应用的边界。通过AI伦理治理,既是规避AI技术的负面影响,引导技术的正向发展,推动公司与行业的可持续发展;同时,这也是业内领先公司、以及所有AI从业者们所应当承担的社会责任。」

从成立之初,商汤的使命便一直没有改变:坚持原创,让AI引领人类进步。也就是说,在商汤将AI落地的过程中,AI的服务对象不应该局限于一个特定的群体,而应该面向整个人类社会。

杨帆提出,AI治理是一个多目标、多维度的平衡过程。比如,防疫期间,保护集体利益的目标与尊重个人行程隐私的目标要权衡;健康码快速人群分类进行针对性防治与老年人数码产品使用问题要权衡等等。

多维目标的权衡,意味着AI治理的难度在增加。为此,商汤伦理委员会整理国际主流的治理观点、以及产业一线的实践经验,提出了AI治理的三大核心:技术可控、以人为本与可持续发展。具体来说,每个核心的表现大约如下:

可持续发展:保护环境、保护和平、包容共享、开放协作、社会认知、敏捷治理……

以人为本:保护人权、保护隐私、人类可控、公平无歧视、造福人类……

技术可控:可验证、可审查、合法性、可信任、可解释、安全可靠、公开透明、负责任……

2、制度式的「技术可控」

值得注意的是,商汤科技在「AI伦理」的参与过程中,不仅是停留在倡议或报告类的书面工作上。商汤的「关键行动」,是率先将「AI伦理」的治理工作贯彻在产品与业务的运营过程中,使之成为商汤企业管理中的一环。

2020年1月,商汤成立了人工智能伦理委员会,从企业的组织架构上渗透「AI治理」的观念。

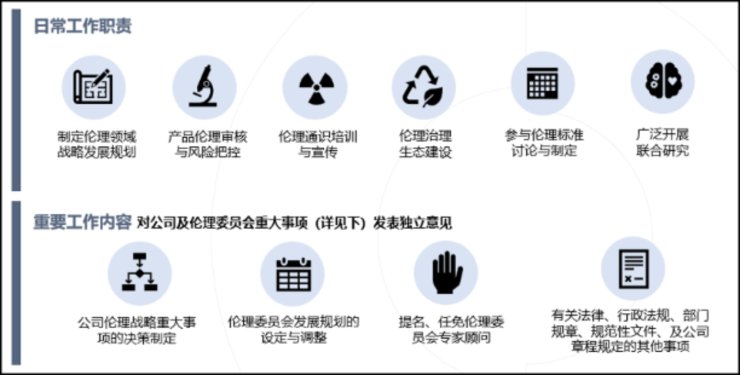

对内,委员会审核商汤的所有落地产品线,对员工进行伦理通识培训,提高员工在日常工作中的伦理意识;对外,与其他组织合作,共同开展AI伦理的研究工作。

文章插图

图注:商汤伦理委员会的职责介绍

另外,该委员会的成员不仅包括商汤内部的核心骨干,还有许多外部专家参与其中。而且,为了保证委员会所作决策的客观与中立,该伦理委员会有一条硬性规定,即外部委员不能少于1/3的席位。

- 40K:Battle|VR动作射击游戏「Warhammer 40K:Battle Sister」即将登陆Steam

- Games|Beat Games透露VR音游「Beat Saber」全新音乐方块类型

- 我们的生活|社交正在推动“孤独生意”多元化发展,天聊将重塑用户精神世界!

- 本周华为小米相继报出的新闻,让我看到中国科技公司未来发展希望

- LG电子正式加入IBM量子网络,将推动量子计算工业应用发展

- 联想Yoga|国产手机支持国产手机产业链的发展?苹果揭开了它们的遮羞布

- 区委领导构筑静安数字经济竞争新优势|促发展、保安全| 区委

- 财智干货|数智化发展任重道远,财务中台提升数据服务价值 | 大数据

- 阿里巴巴|社区团购是互联网巨头的宝地,美团拼多多发展强劲,阿里坐不住了

- 国产手机支持国产手机产业链的发展?苹果揭开了它们的遮羞布