神经|国外科学家创造“超网络”,用于开发人工智能的“人工智能”

人工智能本质上是一场数字游戏。10年前,深度神经网络开始超越传统算法时,表明我们已经有足够的算力去创造人工智能。

文章插图

今天的神经网络对数据的渴望超乎想象,训练他们,需要仔细调整特征中数百万,甚至数十亿参数的值,要想达到理想的程度并不容易。训练可能需要几天、几周甚至几个月的时间。

不过,这一点可能很快就会发生改变。

加拿大圭尔夫大学的Boris Knyazev和他的同事,设计并训练了一个“超网络”,它可以加快神经网络的训练过程。给定一个为某个任务而设计的,完全没有经过训练的深度神经网络,超网络可以在几分之一秒内,预测新网络的参数,理论上新的深度神经网络完全不需要经过训练。

文章插图

由于超网络学习了深度神经网络设计中极其复杂的模式,也被业内人士称为“用于开发人工智能的人工智能。”

目前,超网络在某些环境下表现极佳,但准确率上,它仍然有很大的优化空间。

在CIFAR-10图像数据集上,超网络(GHN-2)在分布式架构上的平均准确率为66.7%,接近使用2500次SGD迭代训练的网络所达到的69.2%的平坤准确率。对于分布式架构,GHN-2表现出人意料的好,达到约60%的准确率。

但是,在ImageNet上表现则比较糟糕,这是一个比较大的图像数据集,GHN-2的准确率只有27.2%。尽管如此,这与使用5000步SGD训练的相同网络的25.6%的平均准确率要高一些。当然,如果继续使用SGD,付出更大的成本可以获得95%的准确率。不过,GHN-2在不到一秒的时间内,便能做出预测,比SGD要快10000倍。

“超网络”并非凭空设计,它的灵感来自图超网络。

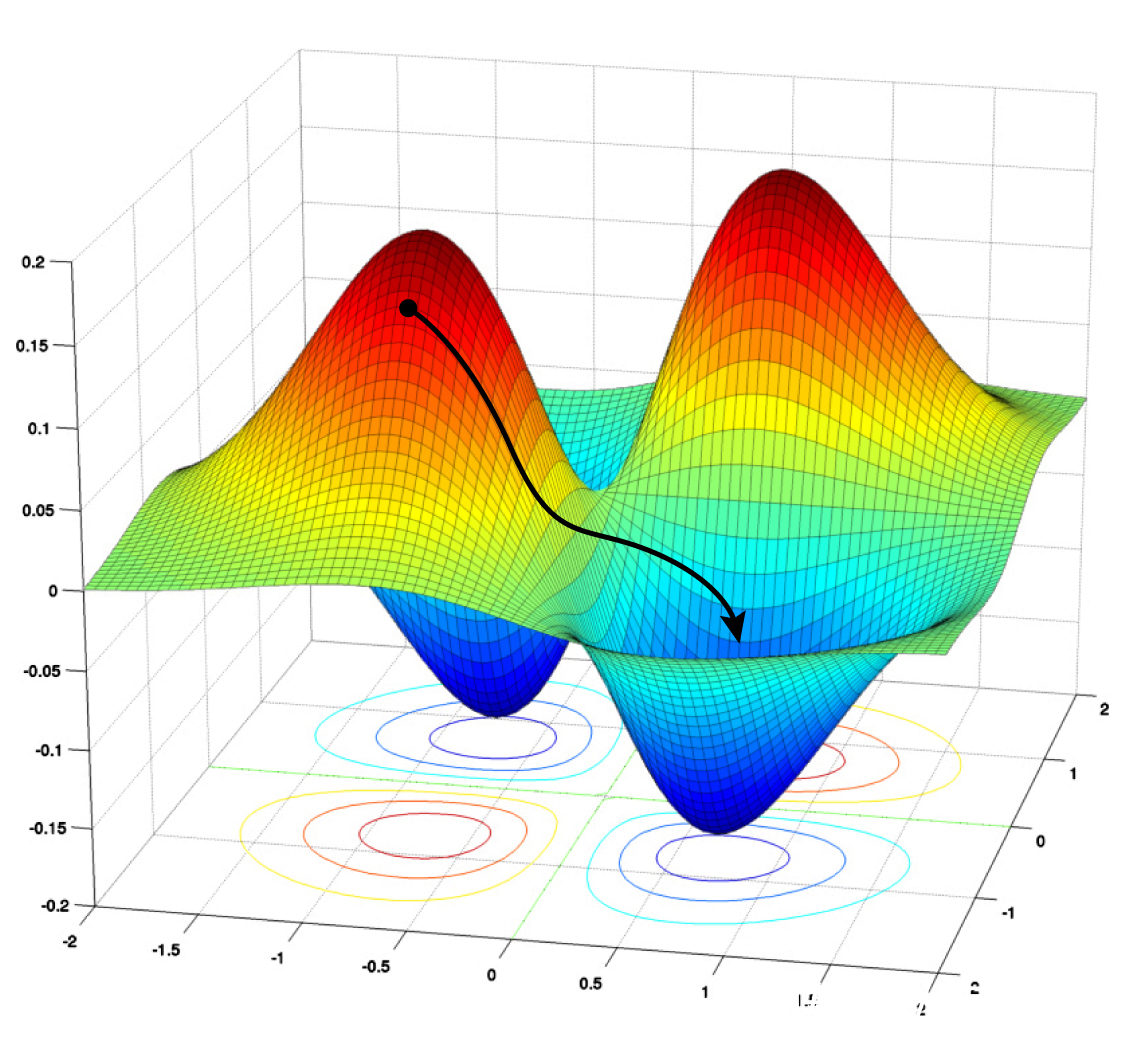

目前,训练和优化深度神经网络的最好方法是随机梯度下降法。但这种方法只有在有网络需要优化时才有效。如果是构建最初的神经网络,一般是由输入到输入多层人工神经元组成,只能依赖工程师的直觉和经验。

文章插图

为了解决这个问题,2018年,Ren、Chris Zhang、Raquel Urtasun三名科学家设计了图超网络(GHN)。它可以在给定一组候选架构的情况下,找到解决某些任务的最佳深度神经网络架构。

超网络便是基于GHN优化而来,创造者Knyazev将超网络命名为“GHN-2”。不过因为GHN并没有开源,Knyazev团队还是从头开始编写自己的软件,并没有抄袭GHN的源码。

文章插图

Knyazev团队取得了一些成功,但他觉得这一方式可能会遭到机器学习社区的反对,因为机器学习从业者更喜欢手工设计算法,而不是基于神秘的深度网络。

【 神经|国外科学家创造“超网络”,用于开发人工智能的“人工智能”】

- OPPO|华为“继承者”出现?两大国产手机合并后,已经火到了国外

- 科技创新工程|我国科学家构建植物代谢调控网络新模型

- 浏览器|假如让谷歌等国外浏览器进入中国,内地浏览器的市占比例会受到很大影响吗?

- realme|又一品牌在国外取得佳绩,realme欧洲增长第一,开始冲击高端市场

- 索尼|柳教父给国外资本进入国内市场铺平了道路

- 糖尿病|科学家发现:淋巴结基质细胞新亚群

- 蒸汽|让冰悬浮?科学家发现新“不粘锅”效应

- 碳化硅|多领域布局,打破国外垄断,晶盛机电成就晶体制造技术专家!

- 社交|柳教父给国外资本进入国内市场铺平了道路

- 小屏手机|小屏再见!科学家给大屏手机正名了:这理由无法拒绝