场景|RTE2021,实时互动技术的进化与蝶变( 三 )

文章插图

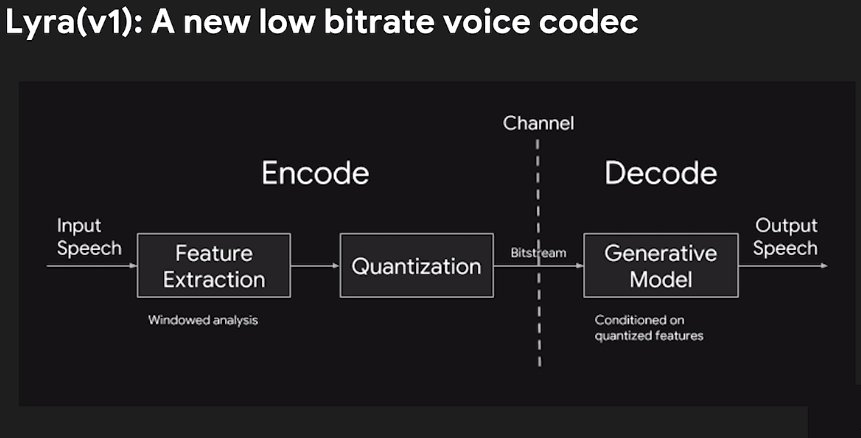

声网的 Silver 语音编解码器则是通过深度学习探索码率、算力和效果的平衡。声网的音频算法团队使用 AI-NS 降噪算法提升语音信噪比,解决噪声问题,以减少低码率带来的 artifact;

编码基于传统算法的分频带特征提取(基频、子带频谱包络、能量等),以及 RVQ、距离编码等方法实现特征编码节省码率;解码采用自回归模型和带宽扩展(BWE)的 WaveRNN 模型实现模型算力的精简。基于自研的多平台 AI 推理引擎实现模型的非对称量化、混合精度推理、计算压缩解码耗时,最终保证移动端部署的实时性。

另外,还有 NVIDIA 深度学习资深解决方案架构师在大会上分享了英伟达从提升算力、结构化稀疏减少算力损耗、模型量化寻找最优算力的深度学习“一增两减”思路。声网 Agora SD-RTNTM 网络传输质量工程师分享,探索声网如何将运维操作的 API 化、平台化,将 AI 和 OPS 拆解成算法-决策-执行,以实现 7*24H 无间断、运维执行的质量和效率。

视频标准与专利发展迅速,期待 AV2 的到来

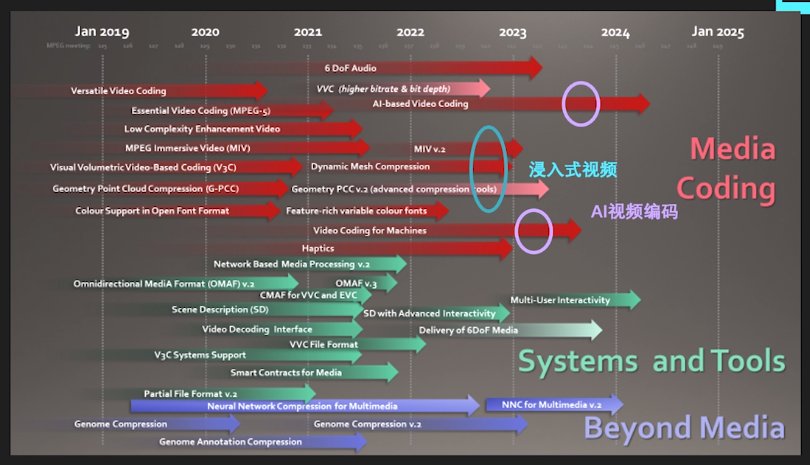

除了 AI 的深入实践,国内厂商在实时音视频领域另一个重要的战场,标准制定上,也在投入大量精力。RTE2021 大会上,参与了高清、4K 等视频国际标准制定的叶琰博士,分享了关于 MPEG、ITU 发展历程,VVC 性能演进详细指标数据,以及视频标准商用落地的最新个人观点。

文章插图

MPEG 发展路径

她很坦率地提出了,已经占据互联网 80% 流量的视频,压缩技术日趋被重视,也将带来专利技术之争,以及专利授权的复杂场景。另外,MPEG 视频相关工作将在 VVC 下一代标准技术研发、AI 视频编码(包含传统框架下提供更高压缩性能、神经网络进行视频压缩两个方向),以及浸入式视频方向发力。

除了视频标准,RTE2021大会上,谷歌工程师也带来了最新的 AV2 编解码器的设计和性能优化成果。上一代 AV1 仅仅在引入实际场景落地的进程中,谷歌的工程师们已经在继续向前,以 0.4~1.5% 的性能提升,探索编解码效率的极限。所以,与 AV2 相关的场景和标准,也将是业界重点关注的工作。

WebRTC 开源与标准之上,声网如何打破“黑盒子”

今年,WebRTC 正式成为 W3C 与 IETF 的官方标准,看起来尘埃落定。不过,WebRTC 开源社区 Committer、声网 Agora WebRTC 负责人毛玉杰在大会上分享了,各组织在 WebRTC Codecs 存在着开源与标准之争的现状问题,以及声网在 WebRTC 标准之上,如何设计 Web 端到端音视频传输架构,降低开发者对实时音视频的使用门槛。

他总结了 WebRTC 的六个现有问题:设备与外设缺乏适配、各类浏览器兼容性、移动端支持不佳、音视频模块不可定制、性能问题、统计数据缺失,目前浏览器厂商并不能全部解决以上问题。声网结合 ORTC、WebRTC Extenions、WebRTC-SVC、Web Transport、Raw-Socket……等多个技术标准,形成了现在声网的 Web 端到端音视频传输架构。

【 场景|RTE2021,实时互动技术的进化与蝶变】

文章插图

声网 Web 端到端音视频传输架构

从 AgoraAI 实时 AI 加速引擎的推出,到在千元机上开启各类 AI 玩法;从 WebRTC 的标准化,到在探索在 Web 端达到 native 端同等的能力;从 RTC 与 IM 融合基础上提供的 aPaaS 到 RTE 万象图谱的发布。过去一年是声网Agora 技术进化的一年,也是实时互联网迈向全新技术阶段的重要变革点,RTE 领域的未来值得我们期待!

- 微信聊天最令人头疼的场景是什么?一定有人会说是对方发来一连串语音还都是超过30秒的长消息...|终于!微信上线万众期待的新功能!网友:总算等到了

- 微信聊天最令人头疼的场景是什么?一定有人会说是对方发来一连串语音还都是超过30秒的长消息...|微信、支付宝,上线新功能

- 微信聊天最令人头疼的场景是什么?一定有人会说是对方发来一连串语音还都是超过30秒的长消息...|终于!微信新增语音暂停功能,60秒长语音不用重头再

- 淘宝|直通车标准计划智能计划销量明星的使用场景?什么时候用什么计划

- 创新大赛|RTE创新大赛三强揭晓 !《实时互动场景创新生态报告》重磅发布

- 华为全场景感恩回馈季来临,多款华为智慧屏值得入手

- 杜蕾斯|品牌场景营销指南

- 碎片化、个性化方式成大众运动新选择,居家场景智能健身火起来了

- 近日国家工信部公示了2021年智能制造试点示范工厂揭榜单位和优秀场景名单|工信部公示:辽宁8企业入围

- 场景三维展示系统,四度科技实现元宇宙的无限穿梭