机器人|人工智能,也应该学会遗忘

文章插图

图片来源@视觉中国

文 | 每日科技前瞻

我们的故事还是从AlphaGo这里说起,无他,我实在是太喜欢这个小家伙了。

在AlphaGo的棋盘招式中,偶有出现之前出现在棋谱里的招式。他通过强化学习,“记住”(至少是我们认为那个意义上的记住)了围棋的局面较优解。这样超凡的学习能力和“记忆力”(虽然运行方式和人类的记忆不同)是AI在这些方面超越人类,出类拔萃的保障之一。

如果把我们代入人工智能的视角,有了这样的记忆力,我们将看到一个学习成本空前降低,创造力勃发的世界。但是当我们有限的记忆芯片被填满之后呢?我们不得不撞上一个名为“遗忘”的问题。

人们有在互联网上提出“被遗忘”的权利,那在人工智能眼前呢?

人工智能,也应该学会“遗忘”。

遗忘,不止应该是对人类人们似乎永远无法完全控制自己的记忆,我们都知道忘记一些事情是什么感觉。即使是那些拥有非凡记忆力的人,也无法确保自己的记忆能够保持多长的时间。

也正是因为此,我们发明了纸笔,发明了硬盘,发明了各种各样能够把我们的记忆以物质记录的方式存留下来的方式。人工智能,也是我们“记住自己”的一种方式。

但是我们的记录与记忆是有选择的:谁都不想把那些不好的回忆在自己的脑海里留存太久,谁都不会去刻意记住生活中繁杂的细枝末节。我们保留了有用的、有价值的记忆,而忘记了价值较低的信息。我们对于这些记忆的物质承载工具大多也是这个态度。

同样,对于AI也应该是这样的,我们应该有能力让一个人工智能忘记它所见证的一切。

“遗忘”对人工智能机器人来说势在必行计算机中的存储器通常用来描述其存储需要回忆的信息的能力,以及存储这些信息的计算机的物理部件。例如,当计算机的工作存储器不再需要某个任务时,在人类的干预下,它会“忘记”数据,从而释放出计算资源用于其他任务。

这也同样适用于人工智能。不过,机器学习算法并不善于知道什么时候保留旧信息,什么时候丢弃过时的信息。比如,非常科幻的“连接主义人工智能”,就面临着几个与“遗忘”有关的问题。比如过度拟合,即学习机器从过去的经验中储存过于详细的信息,从而妨碍了它概括和预测未来事件的能力。

关于这样的“过度拟合”问题,在国外的TowardsDataScience 论坛上,有一位极客为我们分享了他用程序跑出来的例子。

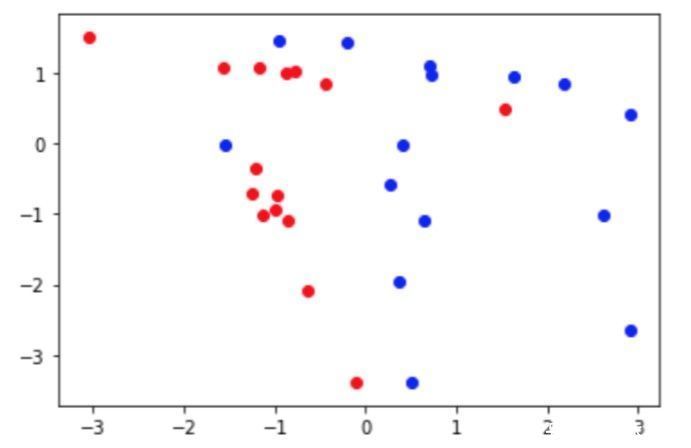

他首先使用sklearn 的“ make _ classification”函数生成一个数据集。并将这些数据集生成的点分成两种颜色,并且放置在同一个平面直角坐标系内,如图所示。

文章插图

注意红点和蓝点的颜色有所区别

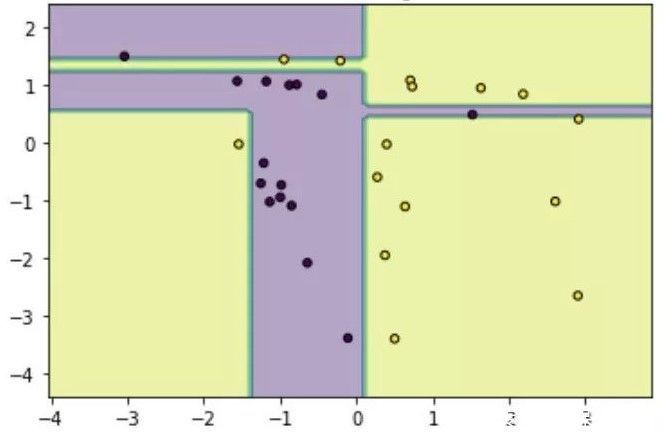

在这项实验中,过度拟合的定义是:反映该模型学习输入的示例,但不能推广到其它示例。比如,在这个系统中,他通过过度拟合要求电脑绘制红色点的存在边界,在编写完相应的程序并且运行之后,电脑给出了这样子的回答。

文章插图

结果

他确实“忠实”地帮我们把红色点与蓝色点区分开了,但是其发现的模式毫无意义,因为生成这些点的规律和自己拟合出来的结果根本就不是一个东西。这样拟合出来的模型,根本没法用。

没有经过“遗忘”提纯,过度拟合的出来的数据,就像人类的“经验主义与教条主义”,比如炒股找类似图形判断未来走势,比如不结合实际情况去找别人的解决方案……不懂得随机应变与因势利导,只会死套公式找公式化的解决方案,但是这样的方案很多时候并不存在。

- CPU|元宇宙+高端制造+人工智能!公司已投高科技超100亿,股价仅3元

- 图灵奖|中国科技团队创历史,360打破行业垄断,登顶世界最强人工智能榜

- 图灵奖|“世界最强”人工智能榜单,“中国代表队”力压群雄登顶榜首

- 白白胖胖头顶起雾走走停停安全无误在哈尔滨站候车厅内一边消毒一边在室内移动的智能消毒机器人...|火车站里的机器人服务,是什么体验?

- 机器人|售价10万的日本“妻子”机器人,除了生娃啥都能做?太天真了

- 王中林|华为全球专利榜第四;京东海外开设机器人零售实体店;Oculus遭反垄断调查|科技周报

- 技术|C端不买单,B端买单难,元宇宙真能帮助人工智能技术学会赚钱?

- 大数据|人工智能步入千家万户,智能机器人的前景怎么样?

- 机器人|中国机器人“独角兽”,抢下国内90%份额,优势还在持续扩大!

- 机器人|老销售是怎么选电销机器人的?如何避坑?这些点需要注意