危险|《网空闲话》:人工智能的危险——任何人都可能成为埃隆·马斯克( 二 )

简化了——也许是过于简化了——这个过程,它针对波利亚科夫的两张照片。其中一张原始照片被上传到PimEyes,以确保这张脸在数据库中。第二种是将Adversa的噪声注入到图像中,让面部识别算法识别出这张照片就是特斯拉和SpaceX的首席执行官埃隆·马斯克。从视觉上看,这张照片仍然是纯粹的波利亚科夫,但当PimEyes在互联网上发现它时,它摄取了这张照片,并将其解读为埃隆·马斯克。

对抗章鱼就是为了改变这一点而造的。Neelou解释道:“我们的目标是强调在现实场景中保护关键任务AI系统的问题。“这就是为什么我们开发了适用于真实环境的高级攻击方法,面部识别是我们的研究目标之一。”

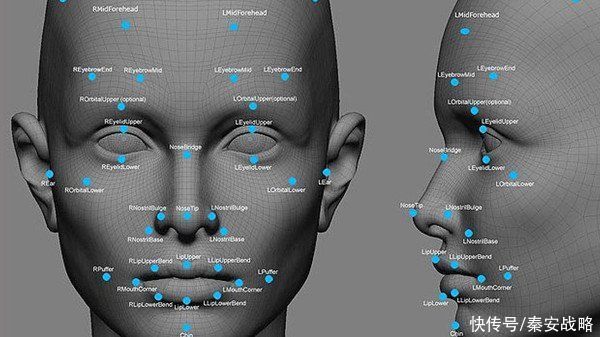

文章插图

对抗性章鱼把理论变成了现实。Neelou说:“已知有针对生物识别安全的演示攻击和深度伪造事件。”“我们的攻击方法可能是执行此类攻击的另一种方式。然而,我们认为伪造数字身份也可以成为诈骗者有利可图的目标。我们认为这种威胁不仅仅是生物识别技术——有许多人工智能算法会根据照片做出关键决定。他们可以成为更大的目标。”

一个相关的博客写道:“黑客活动分子可能会对人工智能驱动的互联网平台造成严重破坏,这些平台使用人脸属性作为任何决策或进一步训练的输入。攻击者可以通过操纵大型互联网公司的个人资料图片毒害或逃避它们的算法。微软总结的机器学习有意的故障/失败和无意的故障的总结。

文章插图

文章插图

网络犯罪分子可以窃取个人身份,绕过银行、交易平台或其他提供认证远程协助的服务中人工智能驱动的生物识别或身份验证系统。这种攻击在任何可以应用传统深度伪造的情况下都可以更加隐蔽。

恐怖分子或持不同政见者可能秘密地利用它在社交媒体上隐藏他们的互联网活动,不让执法部门知道。它就像是我们当前生活的虚拟世界的面具或假身份。”

Neelou认为,问题在于所有深度学习算法从根本上来说都是脆弱的,目前还没有可靠且通用的防御手段。Adversa已经测试了开源人工智能模型和人工智能在线api,发现其中大多数都很脆弱。如果人脸识别供应商将人工智能作为其核心技术,这可能是他们产品安全的最薄弱环节,因为威胁是新的。

文章插图

“与传统软件不同,每个人工智能系统都是独特的,没有通用的安全补丁,”Neelou告诉《安全周刊》。“公司必须在他们的AI开发过程中纳入安全测试——也就是AI红队测试。他们还应该将其实践整合到网络安全生命周期中,包括预测、预防、检测和响应能力。要想通过手工操作、使用开源工具或付费购买商业解决方案来保护自己的人工智能系统,这取决于组织。”但现实是,人工智能系统需要比现在更安全——这正是设计《对抗章鱼》的目的。

目前,Adversa没有公布攻击方法的细节。但是,Neelou表示:“随着研究科学家专注于保护人工智能,我们计划发布一份白皮书,介绍我们的攻击方法的技术细节。”在这一点上,猫将不是简单的鸽子,因为对抗性章鱼,猫可能看起来是鸽子之一。

Adversa.AI公司在其项目声明中表示,他们的AI团队以增加对AI的信任为使命,不断探索评估和保护关键任务AI应用的新方法。

最近,他们发现了一种攻击面部识别系统的新方法,并决定在实践中展示它。他们的演示表明,目前人工智能驱动的面部识别工具很容易受到攻击,可能会导致严重的后果。

- text|《2021大数据产业年度创新技术突破》榜重磅发布丨金猿奖

- 《吉星高照》的谢怜杀青啦,半年的拍摄

- 小米12|自研动态性能调度!小姐姐实测小米12 Pro《王者荣耀》:功耗下降20%

- 联想|4个细节证明:联想并不安全,反而更加危险!

- 《消逝的光芒》开发商保证:游戏将获得 5 年的后续内容更新

- 《长津湖之水门桥》释出终极海报及剧照:准备战斗

- 今日|《战神4》pc版正式解锁dlss和fsr性能表现

- 《三生有幸遇上你》大结局:侯爵遇险,十一舍命相救

- 上海尊宝音响多款产品获《影音极品》器材大赏奖项

- 拯救者|首款无挖孔骁龙8旗舰!拯救者Y90实测30分钟《原神》平均帧率59.2